概率论和随机过程前提知识

随机事件和相关概念

- 什么是随机事件

随机现象:在一定条件下,并不总是出现相同结果的现象,比如抛硬币

随机实验:可重复的随机现象,什么是可重复呢?

就是可以重来,外部条件环境,时间等不会影响结果,例如,抛硬币不受时间和环境影响,但股票的价格是受到环境和时间的影响(比如政策,上一次的股票价格)

需要满足三个条件才能做随机实验:

(1) 同条件下可以重复进行,随机实验之间相互独立。

(2) 满足随机现象,即一次实验,结果不确定,但是所有可能结果已知。

(3) 实验之前未知结果。基本结果:随机现象的结果值,比如抛硬币的结果是正面/反面

基本空间:所有基本结果的全体,比如抛硬币:{正面,反面}

随机事件:随机现象的某些基本结果组成的集合称为随机事件,简称事件,用大写字母A,B等表示,如投掷骰子出现奇数点是一个事件,它由

1,3,5点三个基本结果组成,若记这个事件为A,则A={1,3,5}, 通常记 A事件的取值为a,则a可能值为1,3,5.事件的概率:因为随机事件是随机发生的,因此需要用概率来确定发生的可能性。对必然事件来说,则概率为1,对不可能事件来说,概率为0

而且事件和事件之间也可能有关系,如A事件发生时,B事件发生与否可能和A有关,也可能无关,可能是概率的,也可能是必然的,如A发生的概率为0.6,

若A发生,B也必然发生。

常用P(A=3)表示A事件取值为3,即投掷骰子是奇数3的概率。事件的概率特性:排列和组合,古典概型,主观概率,概率的性质:P(A)+p(~A)=1等

独立性:两个事件是否相互独立,是指两个事件是否相互影响对方发生的概率,若相互独立则满足

P(AB) = P(A)P(B)

这里要注意,独立不一定没有函数关系,这里的函数关系表示事件A,B虽然相互独立不影响,但是满足一定的函数关系。条件概率:重要!!!

条件概率是什么? 条件概率涉及两个事件,A,B,在事件B已发生的条件下,事件A再发生的概率称为条件概率,记为P(A|B).

条件概率反映了两个事件之间的关系。例如,某市有30%的学生视力有缺陷A,7%的学生听力有缺陷B,3%的学生听力视力都有缺陷C。由此经过

计算A,B事件不是相互独立的,在A已发生的情况下,B发生的概率更高。

条件概率的计算:1

2

3

4

5P(A|B) = P(AB)/P(B) ,即在B发生的概率下,AB同时发生的概率即为B发生的条件下A发生的概率。

=> P(AB)= P(A|B)P(B) = P(B|A)P(A)

对比下,若A,B事件相互独立:则P(A|B) = P(AB)/P(B) = P(A) 即不管B发生与否,A的概率都一样。

全概率公式:P(A) 可能在B发生的条件下或B没发生的条件下发生:

P(A) = P(A|B)*P(B) + P(A|~B)P(~B)贝叶斯公式:

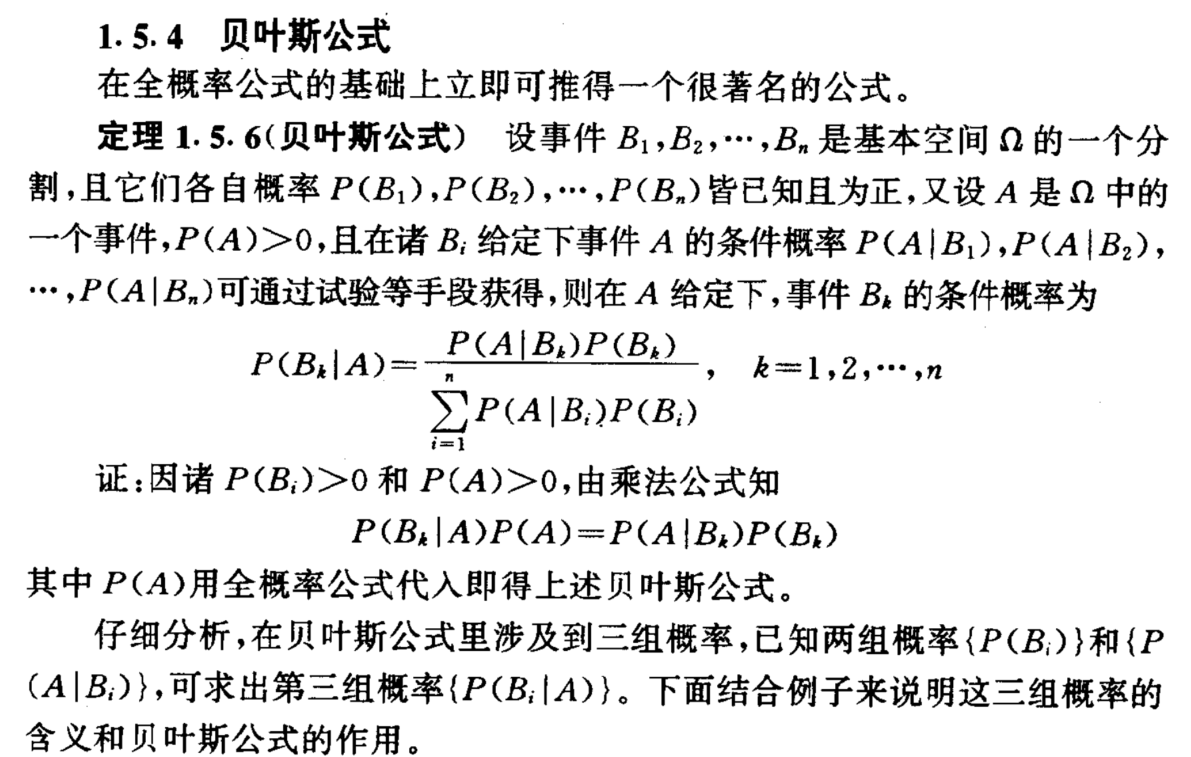

先看看贝叶斯公式:

贝叶斯公式本质上是在求一个条件概率,是A发生的条件下,B发生的概率,本质的公式也是P(A|B) = P(AB)/P(B) 即条件概率的公式。

贝叶斯公式涉及三组概率:{P(Bi)},{P(A|Bi)},{P(Bi|A)}。

那贝叶斯公式为何很重要,是因为在一定条件下,可以用求得的条件概率,来替换原先概率,如用{P(Bi|A)}替换{P(Bi)}

什么情况下可以替换呢?为什么能替换呢?

(1) 当{P(Bi)} 不可信时,而且得出的{P(Bi|A)} 更可信时,凭什么更可信,即{P(A|Bi)} 比较大,粗略来讲。

(2) 为什么可以替换?由P(A) = P(A|B)*P(B) + P(A|B)P(B) 可以知道 P(A)是可以通过条件概率得到的。

应用:应用范围很广,可以用来修正和求得某个事件的概率,通过另一个关联事件。所以对于不能直接求的事件,可以用它关联的事件来求得。

本质上,贝叶斯滤波和卡尔曼滤波等都是这个原理。

随机变量

随机变量常常用来表示要关系的事物,而随机变量的取值则表示该事物发生的事件,根据其概率来了解该事件是否为随机事件。

如:设 抛硬币这个事物为X,则X的取值为正面,即X=1,则表示抛硬币为正面这个事件,X<=1,则表示抛硬币的值为正面/反面这个事件,显然是必然事件。离散随机变量:

若X的取值为可数的,则为离散的连续随机变量:

若X的取值为连续不可数,则为连续随机变量。

概率分布:

离散:

即X取每个可能值的概率,列出来。例如:P(X=1) = 0.5 ,P(X=0)=0.5,所有加上去P=1.

离散随机变量常见事件分布:

二项分布

泊松分布

超几何分布连续:

连续变量的概率分布,因为连续变量是取连续值的,讨论某个值的概率没有意义,->0,所以一般是求某个范围的取值的概率。

将每个取值的概率相加(积分),则等于1,那么如对 p(x)在负无穷到正无穷求积分==1,则p(x) 称为概率密度函数。

求某个范围的取值的密度,比如X<3的取值的概率,则是对p(x)在负无穷到3求积分。

称p(x)为连续随机变量X的概率分布,或密度函数,即为X~p(x),即X服从密度p(x)

pdf: 即概率密度函数:PDF:概率密度函数(probability density function)

常见连续随机变量的概率分布:

正态分布

伽玛分布

贝塔分布

期望,方差等

- 期望:反映平均值

- 方差:反映抖动,稳定情况

随机过程:

对随机变量X, 的每个状态取值 x0,x1,x2…对抛硬币来说,x0和x1.。xn是相互独立的,互不影响,且可重复

而对股票价格事件来说,x0—xn,不是相互独立的,P(x0)和当时的环境有关,不是随机实验。甚至每个x的概率计算方式都不一样。

称x0-xn 是X的一个随机过程。

单个随机变量的贝叶斯滤波

前提:

要知道贝叶斯滤波是在干嘛? 是在求一个概率,或者说修正一个概率。如何修正?

引入:当我们在求一个事件的概率时,会以我们对这个事件的认识程度,给一个概率值,如,某设备优化后,产品生产为高质量的概率为80%,

这个80%可能是我们瞎猜的,或者是我们很粗糙的估计。是一种携带主观的概率。 对抛硬币,1/2的概率猜测,一些人是靠主观,一些是靠大量统计

,即大数定律。

在初始的这个概率,是一个先验概率,主观概率,即在实验之前的), 而贝叶斯的工作,就是通过外部观测,引入证据,信息,来得到一个概率(似然概率,

即上面的{P(A|Bi)},从而求得一个新的概率(在观测发生的情况下)的概率,并用它替换先验概率,这个新概率称为后验概率。

从而达到修正主观概率的目的。这样事件的概率就会变得更准确,当然取决于这个似然概率的准确性。起到一个滤波的作用。

(PS:几个问题: 对事件是否是满足可随机实验的判断,即是否相互独立的判断,也是主观的,因为判断独立性需要概率,但是概率又需要可随机实验

即独立性的判断—鸡生蛋蛋生鸡)

离散

举例,一个离散随机变量的贝叶斯滤波:

设置事件为今天的温度是多少。T

先验概率: P(T=10)=0.8,P(T=11)=0.2

温度计测量的温度 Tm,测出来的温度为10.3

则 1)P(T=10|Tm=10.3) = P(Tm=10.3|T=10)P(T=10) / P(Tm=10.3)

2)P(T=11|Tm=10.3) = P(Tm=10.3|T=11)P(T=11) / P(Tm=10.3)

(先验概率和后验概率都满足概率分布,所有概率相加为1)

则:

P(T=10|Tm=10.3),P(T=11|Tm=10.3) : 后验概率

P(Tm=10.3|T=10),P(Tm=10.3|T=11): 似然概率

P(T=10),P(T=11) :先验概率(主观概率)

P(Tm=10.3): 为一个常数:

由全概率公式:P(A) = P(A|B)*P(B) + P(A|B)P(B)

可以求得 P(Tm=10.3) = P(Tm=10.3|T=10)*P(T=10) + P(Tm=10.3|T=11)*P(T=11) 显然是一个常数。

连续

连续随机变量的贝叶斯公式:

P(X<x|Y=y) = P(Y=y|X<x)P(X=x)/P(Y=y)

这里参考b站的视频,通过积分中值定理和极限定理,将其推导出来:

具体公式,略

- 概率密度函数这里无法确定,只能靠猜测,或者选择,验证,有:

- 等可能模型

- 阶梯型

- 推广,直方图型

- 正态分布。。。

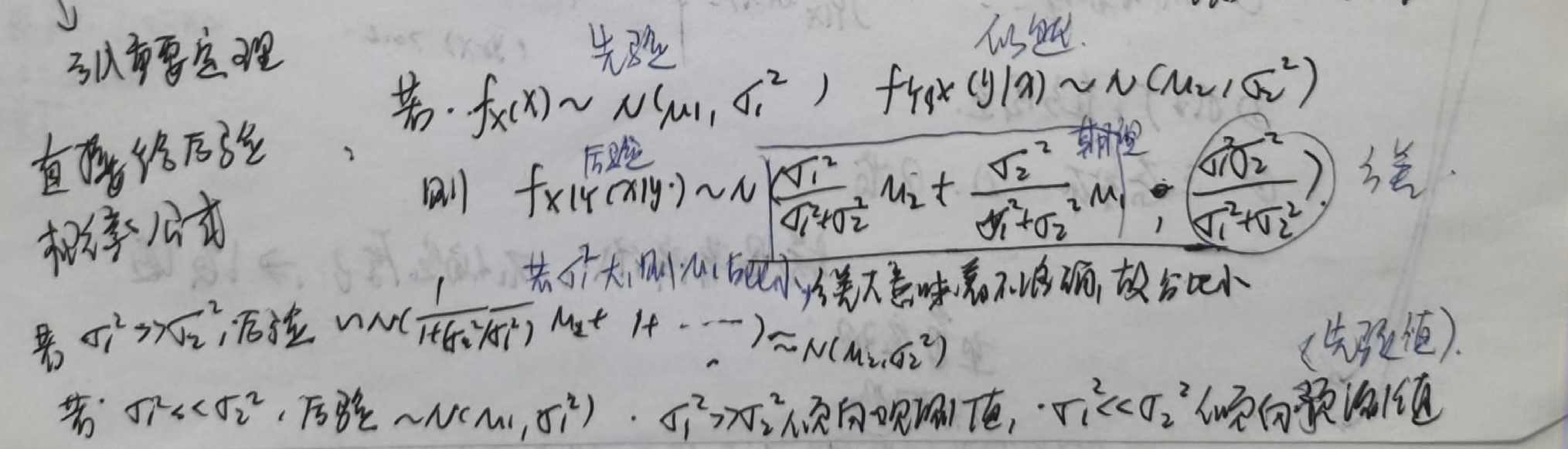

我们选择其中一个代入计算,如正态分布,则可以求得更具体的,先验概率分布,似然概率和后验概率分布。

若选择了正态分布,则:

随机过程和贝叶斯滤波

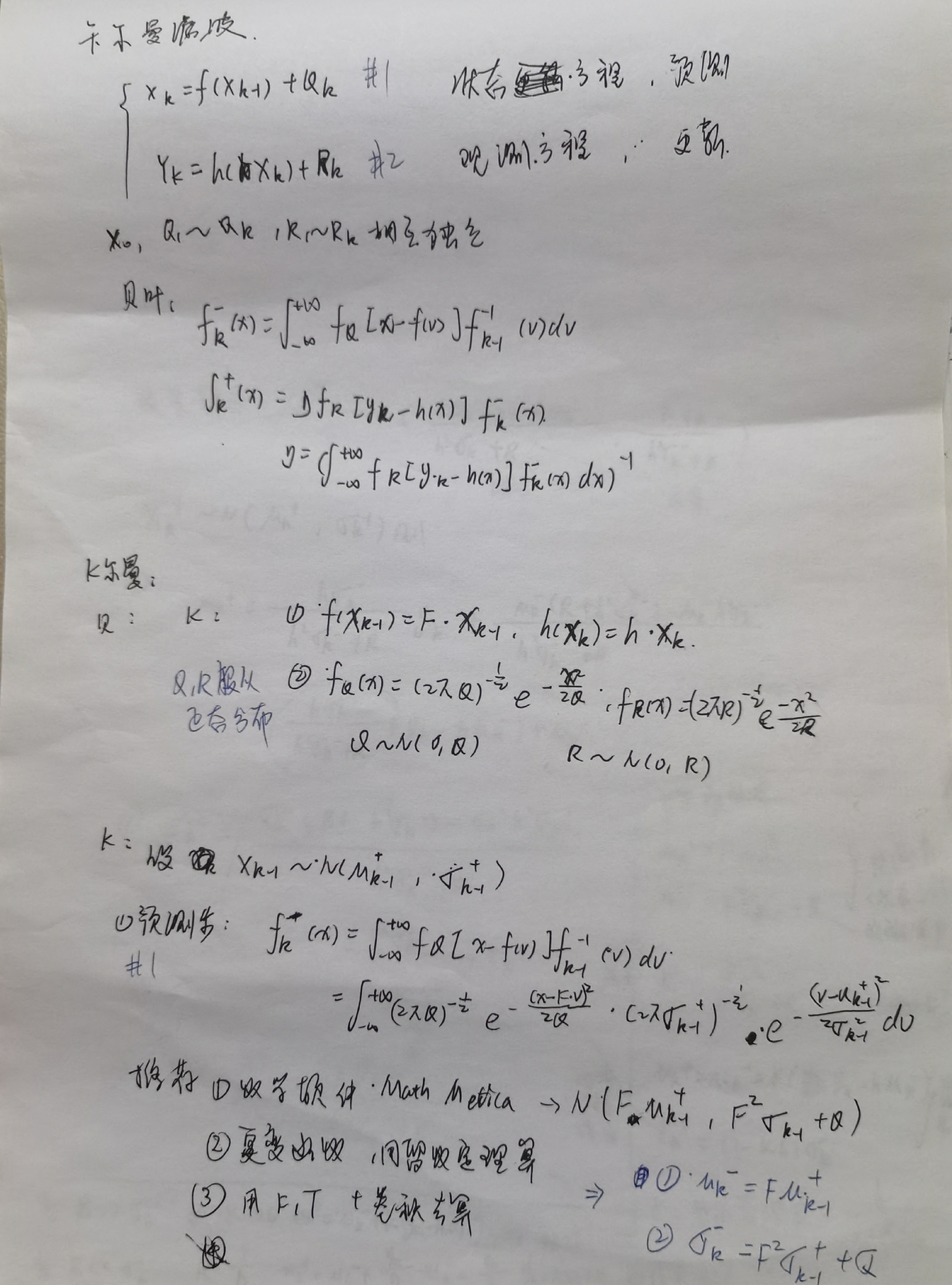

随机过程和单个随机变量求法不太一样,随机过程是由多个随机变量组成。

所以理论上可能有多种解法:

- 1 对随机过程的每个随机变量单独处理,对每个随机变量都按照上面的随机变量的处理方式处理一次,

那这样会引入n个主观概率,完全依赖观测,放弃了n个随机变量之间可能的关系。 - 2 只引入初始的主观概率,利用n个随机变量之间的关系,推导x2-xn,保留和利用了x1-xn之间的关系。

例如,可能xk=2xk-1+Qk

故,这里已知: x1,y1-yn ,y1-yn为观测值。这里:x,y 为随机变量X的取值,观测Y的取值

例子:测温度:

建模:

- 状态方程,即xk,xk+1的关系式,表示随机过程如何演化

Xk = f(Xk-1)+Qk 这里Qk是预测噪声 - 观测方程,即yk和xk的关系式;表示随机过程如何引起观测

Yk = h(Xk) + Rk,这里Rk是观测噪声。 对直接可观测到的值,h(Xk)=Xk,但往往X是速度,而Y是路程,有函数关系。

目标:

1 通过建模的方程和贝叶斯滤波,递推,逐渐更新X的概率分布,这样从x1->xn的取值,或者说,X=x的概率会越来越准确。

2 对求期望,方差,可以通过概率密度函数来求得,也会越来越准确。

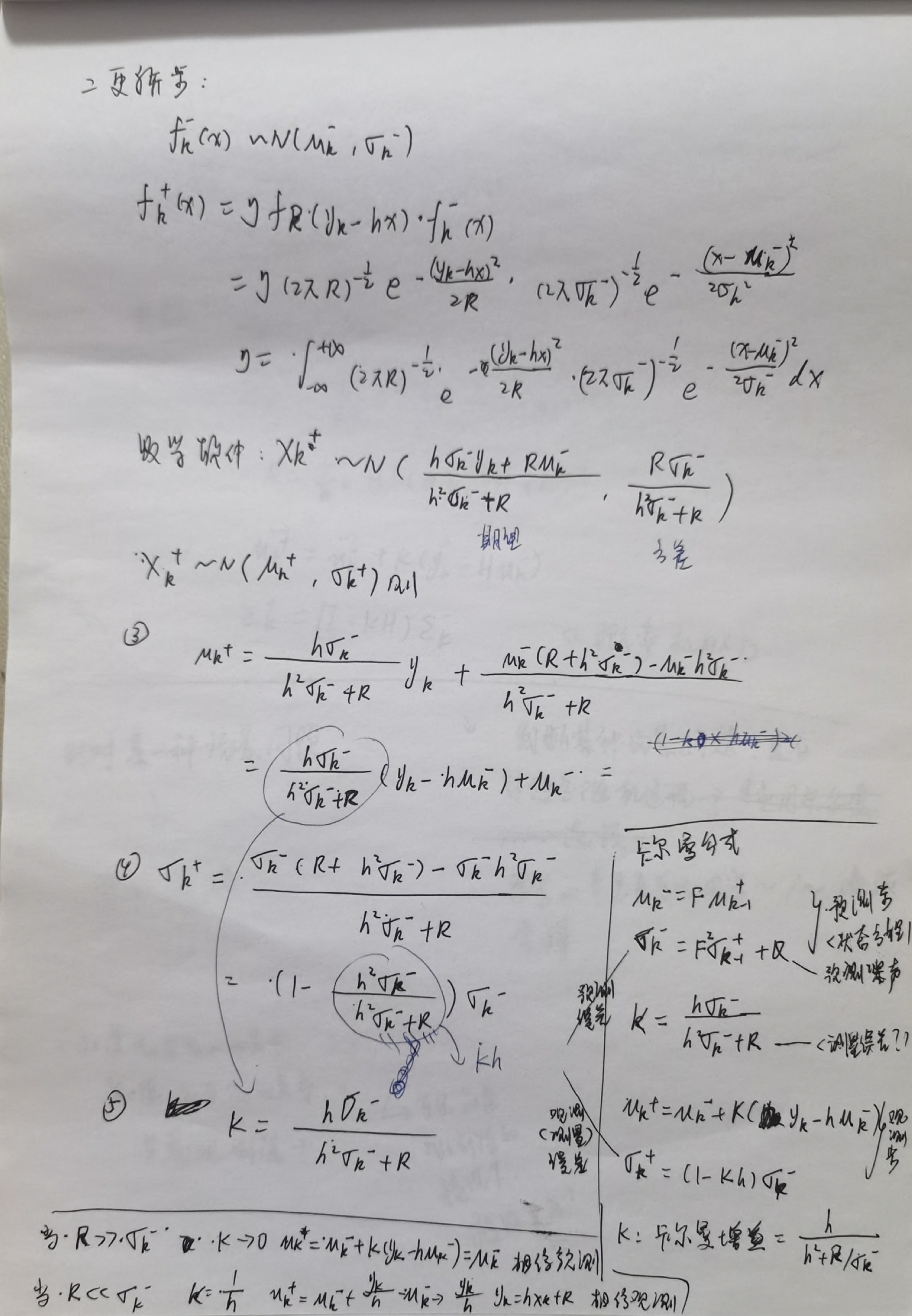

如何递推:

分两步:

- 预测步:上一时刻的后验概率-通过状态方程–>得出这一时刻的先验概率

- 更新步:这一时刻的先验概率-通过观测方程–>得出这一时刻的后验概率/下一时刻的先验概率,

这里的先验,后验是相对来说的。

预测步,通过状态方程和全概率公式,变形推出。更新步通过极限,似然概率和贝叶斯公式推出。具体见文末链接b站大佬的视频。

–>由此得到了我们的目标,但是公式需要求无穷积分等,太难或者说无解,所以为了简化,采用简单的模型假设或其他方法:

- 假设:

设状态方程和观测方程中,f(x),h(x)为线性函数,Qk,Rk,满足正态分布,则

得到的模型,称为卡尔曼滤波,即:

Xk=FXk-1+Qk

Yk=HXk+Rk,F,H为常数。

若f(x),h(x)为非线性函数,则称为扩展的卡尔曼滤波。

- 直接对无穷积分做数值积分:

高斯积分/ 蒙特卡罗积分/ 直方图滤波

卡尔曼滤波

五个公式:

ref:

概率论和数理统计 书籍

https://www.bilibili.com/read/cv5841653?spm_id_from=333.999.0.0 b站老王的相关视频